Freiburg

Studie warnt vor Kontrollverlust in Kriegen durch KI

Der Einsatz Künstlicher Intelligenz in Kriegen birgt laut Experten erhebliche Risiken. Fehlentscheidungen bei Zielauswahl könnten gravierende, kaum kalkulierbare Folgen haben.

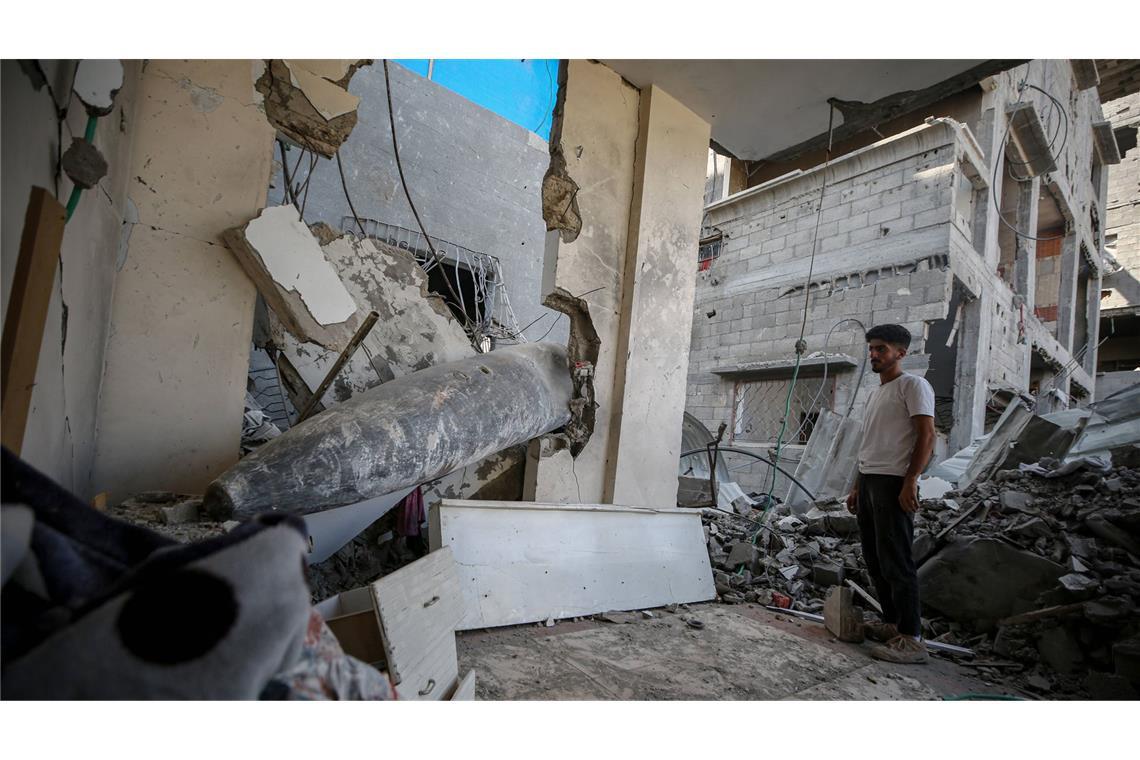

Eine nicht explodierte Bombe in Gaza: KI im Krieg birgt hohe Risiken und kann folgenschwere Fehlentscheidungen auslösen (Symbolfoto).

Von red/epd

Der Einsatz Künstlicher Intelligenz in militärischen Konflikten birgt nach Einschätzung von Experten erhebliche Risiken. KI-Systeme würden bereits in Kriegen etwa im Gazastreifen, im Iran und in der Ukraine eingesetzt, teilte das Centrum für europäische Politik (cep) in einer am Dienstag veröffentlichten Analyse mit. Fehlentscheidungen könnten dabei schwerwiegende und kaum kalkulierbare Folgen haben. KI wird zunehmend bei der Auswahl von militärischen Angriffszielen eingesetzt; davon können sowohl Gebäude als auch Personen betroffen sein.

Zwar seien Menschen formal in Entscheidungsprozesse eingebunden, tatsächlich gerate diese Kontrolle aber zunehmend an ihre Grenzen, heißt es. Zeitdruck, eine Vielzahl zu prüfender Zielvorschläge sowie mangelnde Transparenz der Systeme führten dazu, dass sich Bediener oft auf KI-Einschätzungen verließen. „Unter diesen Bedingungen wird aus Kontrolle schnell Abhängigkeit“, sagte cep-Experte Anselm Küsters laut Mitteilung.

Gemeinsame Regeln ethisch geboten und militärisch sinnvoll

Das cep fordert daher verbindliche internationale Standards für den militärischen Einsatz von KI. Dazu zählten unter anderem Offenlegungspflichten, Begrenzungen für automatisierte Systeme sowie Meldepflichten bei Fehlfunktionen. Gemeinsame Regeln seien nicht nur ethisch geboten, sondern auch militärisch sinnvoll, da sie Fehlangriffe reduzierten und Eskalationen vorbeugten. Als möglicher Ausgangspunkt werden europäische oder Nato-weite Standards genannt, die in internationale Vereinbarungen münden könnten.